原文链接 http://www.lelovepan.cn/2015/11/25/%E5%8F%B0%E5%A4%A7%E6%9C%BA%E5%99%A8%E5%AD%A6%E4%B9%A0%E5%9F%BA%E7%9F%B3.html

注:以下为加速网络访问所做的原文缓存,经过重新格式化,可能存在格式方面的问题,或偶有遗漏信息,请以原文为准。

1. 机器学习是不可能的

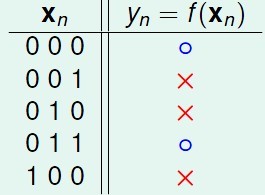

我们先来看一个简单的二分问题:

if :

can enumerate all candidate f as H?

看似这个问题不难!输入一共可以有种,那么hypothesis set大小就为了。现在给出训练样本集(in-sample),

我们选择一个机器学习算法从Hypothesis set中选出一个g,( )

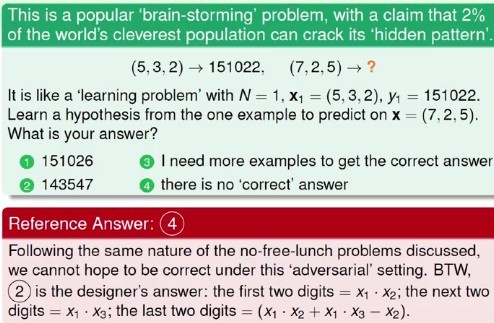

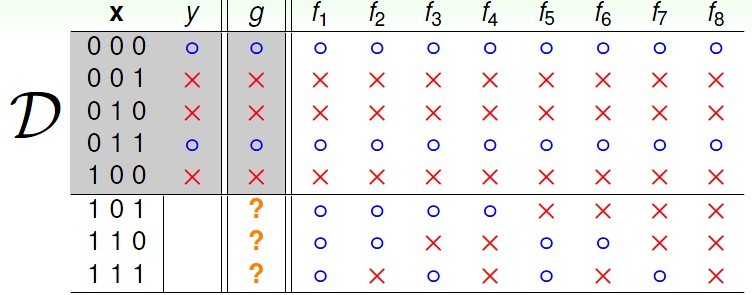

我们当然可以像感知机(PLA)那样,能够找出一个或者若干个好的g,在训练样本集(in-sample)上把所有的样本分对。上例中, No Free Lunch

我们可以在5个已经给出的输入上面得到g的预测是否正确,但是在未看过的三个输入上呢?我们会发现其实还有8种可能的选择。所以

- g f inside D:sure!

- g f inside D:NO!but that's really what we want!

在训练样本集(in-sample)中,可以求得一个最佳的假设g,该假设最大可能的接近目标函数f,但是在训练样本集之外的其他样本(out-of-sample)中,假设g和目标函数f可能差别很远。 下面的练习题很简单,如果你做错了,说明这节课的还没有很好掌握奥...